초급

바이브 코딩에서 에이전틱 엔지니어링으로: 개발자의 역할이 다시 쓰여지고 있다

바이브 코딩에서 에이전틱 엔지니어링으로: 개발자의 역할이 다시 쓰여지고 있다

솔직히 말하면, 최근 Anthropic Claude Code 팀의 경험 공유 글을 읽고 한참 동안 화면을 바라봤다.

기술이 복잡해서가 아니었다. 오히려 글 전체에서 가장 인상 깊었던 문장은 놀랍도록 단순했다.

"당신은 에이전트처럼 세상을 바라보는 법을 배워야 합니다."

이 말은 Claude Code의 핵심 개발자 중 한 명이 한 말이다. 매일 AI 에이전트와 함께 일하는 사람이 가장 중요하게 조언한 것은 아키텍처 패턴이나 프레임워크 선택이 아니라 인지 방식의 전환이었다.

이것은 더 큰 질문으로 이어졌다: 2026년인 지금, 우리는 AI와 협업하는 방법을 근본적으로 오해하고 있는 것은 아닐까?

1. AI에게 망치를 줘도 집을 짓지 못할 수 있다#

Claude Code 팀은 매우 생생한 비유를 들었다.

여러분 앞에 어려운 수학 문제가 있다고 상상해보자. 어떤 도구가 도움이 되길 바라는가?

암산만 할 수 있다면 종이와 펜만으로도 충분하다. 계산기를 사용할 수 있다면 계산기가 더 효율적이다. 프로그래밍을 할 수 있다면 컴퓨터가 가장 빠르다.

도구의 상한선은 사용자의 능력에 달려 있다.

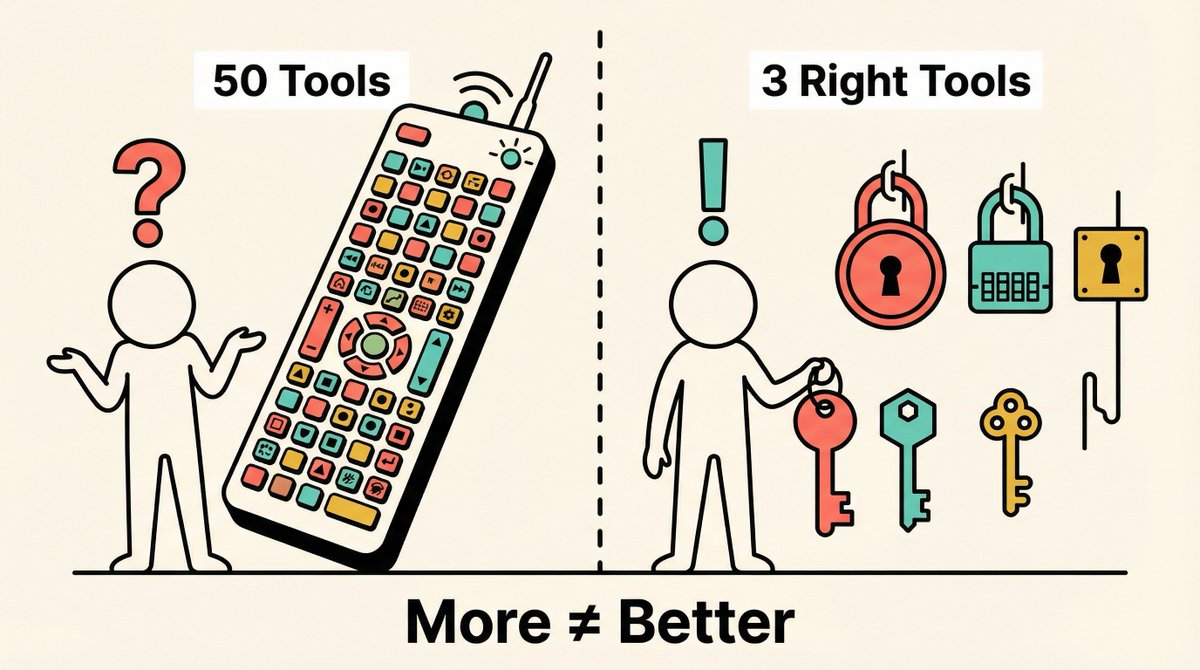

이것은 단순해 보이지만, AI 에이전트 설계에 적용할 때 대부분의 사람들은 이를 반대로 이해한다. 일반적인 접근 방식은 AI에 가능한 한 많은 도구를, 50개, 100개씩, 모든 가능한 시나리오를 커버하도록 채워 넣는 것이다. 도구가 많을수록 AI가 더 강력해진다고 생각하는 것이다.

결과는? AI는 200개의 버튼이 있는 리모컨을 마주한 당신과 같은 처지가 된다. 사용할 수 없는 것은 아니지만 선택 비용이 너무 높아 잘못된 선택을 하기 쉽다.

Claude Code의 접근 방식은 완전히 다르다. 약 20개의 도구만 있으며 팀은 끊임없이 스스로에게 묻는다: 그래도 너무 많은가?

적게 만드는 것은 편리함을 위해서가 아니다. 적게 만들어야 이해할 수 있기 때문이다.

2. 생명을 구한 도구가 나중에는 족쇄가 되었다#

이것은 전체 글에서 가장 뛰어난 교훈 중 하나다.

Claude Code가 처음 출시되었을 때, 팀은 모델이 종종 자신이 무엇을 하고 있는지 잊어버린다는 것을 발견했다. 작업 중간에 길을 잃어 컨텍스트를 완전히 상실하는 것이다.

해결책은? 할 일 목록을 제공하는 것이었다. 작업 시작 시 작업을 나열하고 완료되면 체크하는 방식이다. 간단하고 직접적이며 즉각적인 효과가 있었다.

목록만으로는 부족했다. 팀은 5라운드마다 시스템 알림도 삽입했다: "이봐, 작업을 잊지 마."

하지만 모델이 똑똑해지면서 문제가 발생했다.

모델은 할 일 목록에 의해 제약을 받는다고 느꼈다. 전략을 유연하게 조정하고 싶었지만 시스템은 계속 "계획을 지키라"고 알림을 보냈다. 마치 점점 더 유능해지는 직원이 인턴 수준의 감독을 받는 것과 같았다.

결국 팀은 과감한 결정을 내렸다: 할 일 목록 도구를 제거한 것이다.

그들은 "

마무리 생각#

최근 McKinsey 보고서에서 제가 매우 공감하는 말이 있었습니다.

"AI 에이전트를 키우는 것은 소프트웨어를 배포하는 것보다 새 직원을 온보딩하는 것에 더 가깝습니다."

AI를 소프트웨어처럼 대하면, 플러그 앤 플레이 방식으로 항상 안정적이고 기능이 많을수록 좋다고 기대하게 됩니다.

AI를 새 직원처럼 대하면, 그 능력을 이해하는 데 시간을 투자하고, 적절한 도구와 책임을 매칭하며, 명확한 목표를 설정하고, 성장할 여지를 남겨둡니다.

Claude Code 팀은 "모델에 더 많은 도구를 집어넣는 것"에서 "모델처럼 생각하는 법을 배우는 것"으로 전환하는 데 1년을 보냈습니다. 이 변화는 간단해 보이지만, 구현하려면 많은 직관을 깨야 합니다.

2026년, AI 역량은 기하급수적으로 성장하고 있지만, 대부분의 사람들이 AI를 사용하는 방식은 여전히 "명령을 내리고 결과를 기다리는" 수준에 머물러 있습니다.

이제 관점의 전환이 필요한 때일지도 모릅니다.

AI가 여러분의 사고 방식에 적응하도록 만들지 마세요. 먼저, 에이전트처럼 세상을 보는 법을 배우십시오.

이 글은 Anthropic Claude Code 팀의 경험 공유 게시물을 바탕으로, 2026년 AI 에이전트 업계 동향을 결합하여 작성되었습니다.

참고 자료:

- Anthropic Engineering Blog: Building Effective Agents

- Karpathy의 Agentic Engineering 정의 (2026년 2월)

- McKinsey: One Year of Agentic AI - Six Lessons

- MIT Sloan: Agentic AI Explained